特征选择概述

在向量空间模型中,文本可以选择字、词组、短语、甚至“概念”等多种元素表示。这些元素用来表征文本的性质,区别文本的属性,因此这些元素可以被称为文本的特征。在文本数据集上一般含有数万甚至数十万个不同的词组,如此庞大的词组构成的向量规模惊人,计算机运算非常困难。进行特征选择,对文本分类具有重要的意义。特征选择就是要选择那些最能表征文本含义的词组元素。特征选择不仅可以降低问题的规模,还有助于分类性能的改善。选取不同的特征对文本分类系统的性能有不同程度的影响。已提出的文本分类特征选择方法比较多,常用的方法有:文档频率(Document Frequency,DF)、信息增益(Information Gain,IG)、 卡方( χ2)校验(CHI)和互信息(Mutual Information,MI)等方法。另外特征抽取也是一种特征降维技术,特征抽取通过将原始的特征进行变换运算,形成新的特征。

常见模型

文档频率(DF)

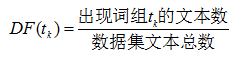

某一词组出现在文档中的频率称为文档频率(DF)。计算形式如式所示:

基于文档频率的特征选择一般过程:

1) 设定文档频率DF的上界阈值∂u 和下界阈值∂l;

2) 统计训练数据集中词组 的文档频率 ;

3) ∀ DF(tk)< ∂l:由于词组tk 在训练集中出现的频率过低,不具有代表性,因此从特征空间中去掉词组tk

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?